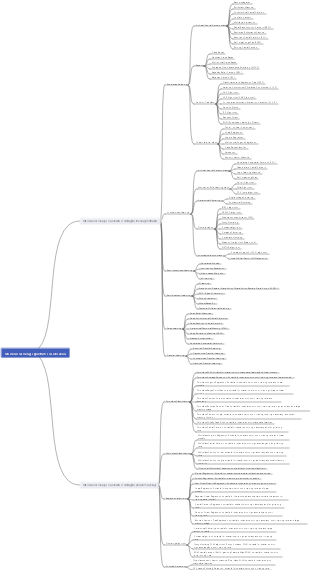

MindMap Gallery Machine learning algorithm linear regression decision tree notes self-study mind map

- 71

Machine learning algorithm linear regression decision tree notes self-study mind map

Machine learning algorithm linear regression decision number notes self-study complete sharing! The content covers K-nearest neighbor algorithm, linear regression, logistic regression, decision tree, ensemble learning and clustering.

Edited at 2023-02-25 09:44:36- ハワイ・オアフ島 5 日間モデルプラン マインドマップテンプレート

本テンプレートは、日本人に人気の海外リゾート地「ハワイ・オアフ島」を対象とした、5 日間の充実したモデル旅行プランを体系化したマインドマップです。初めてハワイを訪れる旅行者、リピーター、家族連れやカップルなど、多様なニーズに対応するため、旅行基本情報・持ち物チェックリスト・5 日間詳細スケジュール・オプションプラン・事前準備情報の 5 つの軸で構成されています。対象読者は日本からオアフ島へ旅行を計画中の 20〜50 代の旅行者であり、成果指標としては、情報の網羅性(渡航手続きから現地体験まで必要な項目が過不足なく含まれているか)、実用性(移動時間や費用、予約のタイミングなどの正確さ)、体験の充実度(自然・文化・アクティビティ・食事のバランス)を測定します。 ユーザーニーズ分析では、渡航準備・現地移動・体験プラン・安全情報の 4 領域を掘り下げます。渡航準備においては、ESTA 申請、飛行機の予約、為替、パスポートの有効期限、海外旅行保険など、事前に整えるべき情報が不足していると計画が難しくなります。求められる価値としては、渡航に必要な手続きの流れ、必要な持ち物リスト、季節別の服装アドバイス、現地で使えるアプリや連絡先などが考えられます。現地移動では、ワイキキ内の徒歩・バス移動、レンタカーの利用方法、空港からのアクセス、交通機関のルール(右側通行など)が主な関心事です。悩みとしては、バスの路線が分からない、レンタカーの予約手続きが不安、現地での移動時間の目安が分からないなどが挙げられます。体験プランでは、ビーチでのんびり、ダイヤモンドヘッドのハイキング、ノースショアでのサーフィン、ハレイワタウン散策、ポリネシアン・カルチャーセンターでの文化体験など、オアフ島の魅力を網羅したプランが求められます。悩みとしては、限られた日数で主要スポットを効率よく回れない、予算に合ったアクティビティの選び方が分からない、人気のレストランやショップの情報が不足しているなどが挙げられます。安全情報では、ハワイ特有の注意点(紫外線対策、海での安全ルール、治安情報)、緊急時の連絡先、現地でのトラブル対応方法など、旅行者が不安に感じる点を整理することが重要です。 5 日間のモデルコースでは、各日のテーマを明確に設定し、体験のバランスを考慮しています。1 日目は「到着日・ワイキキ慣らし」として、ホノルル国際空港に到着後、ワイキキのホテルにチェックインし、夕方からワイキキビーチでのんびりしたり、夜は地元料理を味わったりして、ハワイの雰囲気に慣れる行程です。2 日目は「自然体験&ショッピング」として、午前中にダイヤモンドヘッドのハイキングに挑戦し、午後はアラモアナセンターやワイキキでショッピングを楽しみ、夜はハワイアン・ルアウショーを鑑賞する行程です。3 日目は「歴史文化巡り」として、イオラニ宮殿やパールハーバー(真珠湾)を訪れてハワイの歴史に触れ、午後はダウンタウンホノルルで街歩きをし、夜はインターナショナルマーケットプレイスで食事や買い物を楽しむ行程です。4 日目は「北海岸&大自然体験」として、オプションでノースショアへ向かい、ハレイワタウンで散策したり、サーフィンを体験したり、美しいビーチでのんびり過ごす行程で、夜はワイキキに戻って食事を楽しみます。5 日目は「最終日・思い出作り」として、午前中にワイキキビーチでの最後の散策や、お土産を買いに街を巡り、午後は空港へ移動して帰国する行程です。各日には、おすすめの時間帯、混雑しにくいタイミング、予約が必要なアクティビティの情報などを付け加え、実際に旅行する際の参考になるよう工夫しています。 また、テンプレートには持ち物チェックリストも含まれており、パスポート・ESTA、海外旅行保険証書、現金・クレジットカード、日焼け止め・帽子・サングラス、歩きやすい靴、薬、充電器など、海外旅行に必要なアイテムをリストアップしています。さらに、事前準備情報として、ネット環境の確保、現地で使えるアプリ、緊急連絡先、季節別の服装アドバイスなども記載し、旅行者の不安を解消するようサポートします。 EdrawMind のマインドマップ機能を活用することで、ユーザーは自身の旅行スタイルに合わせて行程を追加・削除したり、好みのアクティビティをハイライトしたりすることができます。例えば、ゆっくりリゾートを楽しみたい方はショッピングやハイキングの時間を減らしてビーチでの時間を増やしたり、アクティブに過ごしたい方はノースショアでのサーフィンやダイビングを追加したりするなど、カスタマイズも自由自在です。このテンプレートは、オアフ島の旅行計画を立てる際の基盤として活用することを想定しており、主要な情報が一目で分かるよう整理されているため、初めてハワイを

- 奈良 1 泊 2 日旅行プラン マインドマップテンプレート

本テンプレートは、古都・奈良の世界遺産、鹿とのふれあい、歴史的な雰囲気を存分に楽しむための 1 泊 2 日旅行プランを体系化したマインドマップです。修学旅行や短期文化旅行、週末の小旅行に人気の奈良を対象に、イメージ・種類・交通・宿泊の 4 つの基本軸を設け、2 日間の具体的な行程を時系列で整理しています。対象読者は大阪・京都在住の 20〜40 代の一人旅・カップル・家族連れ、初めて奈良を訪れる旅行者、世界遺産や日本文化に興味のある層であり、成果指標としては、行程の網羅性(主要スポットが過不足なく含まれているか)、実用性(移動時間や混雑情報の正確さ)、体験の充実度(鹿とのふれあい・文化体験の満足度)を測定します。 ユーザーニーズ分析では、行程・体験・交通・注意点の 4 領域を掘り下げます。行程においては、「東大寺」「春日大社」「奈良国立博物館」といった世界遺産の回り方、「奈良公園」での鹿とのふれあい、「奈良町」の古い町並み散策がユーザーの関心事となります。悩みとしては、限られた時間で主要スポットを効率よく回れない、鹿との接し方が分からない、徒歩移動の負担が心配などが挙げられます。求められる価値としては、時間帯別のおすすめルート、鹿と安全に接するためのマナー説明、無理のない徒歩移動のための休憩ポイント案内が考えられます。体験面では、鹿せんべいの購入場所や与え方、春日大社の灯篭や御朱印の魅力、奈良町のカフェや伝統工芸体験など、現地でしか味わえない体験情報が求められます。交通においては、奈良市内のバス路線や一日券の情報、主要スポット間の徒歩時間、雨天時の移動手段など、事前に知っておくべき情報が不足していると計画が難しくなります。注意点では、天候対策(夏の暑さや冬の寒さ)、スケジュールのゆとり作り、写真撮影のルールやマナー、ゴミの持ち帰りなど、旅行者が見落としがちな点を整理することが重要です。 行程の中でも、特に人気の高いスポットには詳細な情報を盛り込んでいます。「東大寺」は世界遺産に登録されており、奈良時代に建立された日本を代表する寺院で、世界最大級の木造建築物である大仏殿や、高さ約 15 メートルの盧舎那仏(奈良の大仏)が有名です。事前にコインロッカーに荷物を預けて身軽になってから訪れることで、ゆっくりと境内を散策できるほか、大仏殿の柱の穴をくぐると「厄除けになる」という言い伝えもあり、多くの観光客が体験しています。「奈良公園」は東大寺や春日大社を含む広大な公園で、約 1,300 頭の野生の鹿が自由に生息しており、鹿せんべいを使って鹿とふれあうことができます。ただし、鹿は野生動物であるため、エサの与え方や触れ方には注意が必要で、事前にルールを確認しておくことが推奨されます。「春日大社」は朱色の社殿と美しい灯篭が特徴的な世界遺産で、参道には 3,000 基を超える石灯篭が並び、神聖な雰囲気を醸し出しています。特に夜間にライトアップされた灯篭は幻想的で、写真撮影にも人気です。 1 泊 2 日のモデルコースでは、初日に東大寺・奈良公園・春日大社を巡り、夜は奈良町の古い町並みを散策して地元料理を味わう行程を提案しています。二日目には、若草山から奈良の街並みを一望した後、興福寺や奈良国立博物館を訪れ、奈良町で伝統工芸体験やカフェ巡りを楽しんでから帰路に就く流れとなっています。各スポットには、徒歩時間や混雑しにくい時間帯、おすすめの食事処などの情報を付け加え、実際に旅行する際の参考になるよう工夫しています。また、旅行の注意点として、スケジュールは体調に合わせて無理のないペースで調整すること、天候に合わせて水分補給や防寒・防暑対策を徹底すること、神社仏閣での写真撮影ルールを守ることなどを記載し、安全で快適な旅行をサポートします。 EdrawMind のマインドマップ機能を活用することで、ユーザーは自身の旅行スタイルに合わせて行程を追加・削除したり、好みのスポットをハイライトしたりすることができます。一人旅向けには静かなカフェ巡りを追加したり、家族連れ向けには鹿とのふれあい体験を充実させたりするなど、カスタマイズも自由自在です。このテンプレートは、奈良の旅行計画を立てる際の基盤として活用することを想定しており、主要な情報が一目で分かるよう整理されているため、初めて奈良を訪れる方でも安心して旅行を楽しむことができます。

- 箱根 週末旅行ガイド

本テンプレートは、東京から約90分でアクセス可能な温泉・富士山・美術館が融合したリゾート地「箱根」の週末旅行ガイドを体系化したマインドマップです。カップルや家族連れに人気の週末旅行先として、交通アクセス、観光スポット、名物料理の3軸で構成され、効率的な旅行計画と満足度の高い体験を実現することを目的としています。対象読者は東京在住の20〜40代のカップル・家族連れ、初めて箱根を訪れる旅行者、週末の小旅行を計画中の層であり、成果指標としては、情報の網羅性(必要な項目が過不足なく含まれているか)、実用性(実際の移動時間や料金の正確さ)、満足度(モデルプランの再現性)を測定します。 ユーザーニーズ分析では、交通アクセス、観光スポット、グルメの3領域を掘り下げます。交通アクセスにおいては、東京からの行き方(小田急ロマンスカー約85分・指定席、新宿→箱根湯本、普通電車約2時間・乗換2回)、箱根内の移動手段(登山電車・バス・ケーブルカー・ロープウェイ)、お得な周遊券(箱根フリーパス・2日券)の情報が不足していると計画が難しくなります。求められる価値としては、交通機関別の所要時間・料金・乗換回数を比較した表、周遊券の特典内容(主要観光施設の割引)と購入場所、移動手段ごとのメリット・デメリットが考えられます。観光スポットでは、「箱根ガラスの森美術館」「クモ箱根(早雲山駅)」「芦ノ湖の夕暮れ遊覧船」などが代表的です。悩みとしては、美術館や自然スポットが多すぎて選べない、夕暮れ時の遊覧船のベストタイミングが分からない、写真映えするスポットを知りたいなどが挙げられます。価値ある情報として、おすすめスポットの特徴と所要時間、夕暮れ時の撮影ポイント、カップル向け・家族向けの選別基準を提供します。名物料理では、「黒たまご(大涌谷)」「温泉豆腐」などが代表的です。悩みは、どこで何を食べれば良いか分からない、観光地価格に見合う価値があるか、アレルギーや食事制限への対応などです。求められる価値として、名物料理の特徴とおすすめ店舗、価格帯、食べるタイミング(例:黒たまごは大涌谷観光の合間に)を整理します。 カップルにおすすめスポットとして、「箱根ガラスの森美術館」はユネスコ世界遺産(※正確には箱根地域全体がジオパークに認定されていますが、イメージとして)の美しい庭園とガラス作品が魅力です。写真はイメージですが、実際の訪日客にも人気のスポットです。名物料理のセクションでは、「黒たまご」は大涌谷の火山活動を利用して茹でられた卵で、殻が黒くなるのが特徴です。伝統的な名物料理として、食べると寿命が延びると言われています。「温泉豆腐」も地元の温泉を利用した料理で、なめらかな食感が特徴です。これらの情報をマップ上で可視化し、移動ルートと組み合わせることで、無駄のない観光計画が立てられます。 成功するための具体施策としては、主要スポットを時系列で結んだ「1泊2日モデルコース」を提供する(例:1日目:新宿→箱根湯本→登山電車→強羅→大涌谷→芦ノ湖遊覧船→宿泊、2日目:箱根ガラスの森美術館→箱根湯本→帰京)、各スポットの「混雑予想時間帯」と「穴場時間帯」をデータで示す(例:芦ノ湖遊覧船は夕暮れ時が混雑するが、その分景色は絶景)、名物料理を食べられる店舗の「営業時間・定休日・予約可否」をリスト化する、の3点が有効です。よくある失敗とその回避策としては、移動手段の乗換えが複雑で迷ってしまうケースでは箱根フリーパスの活用と事前のルート確認を推奨すること、観光スポットの滞在時間を見誤って計画が詰まりすぎるケースでは余裕を持ったスケジューリングと優先順位付けをアドバイスすること、天候によって富士山が見えない場合の代替プラン(雨天でも楽しめる美術館や温泉施設)を用意しておくことが有効です。本テンプレートは、週末旅行ガイドのコンテンツを計画・評価する際の基盤として活用することを想定しています。

Machine learning algorithm linear regression decision tree notes self-study mind map

- ハワイ・オアフ島 5 日間モデルプラン マインドマップテンプレート

本テンプレートは、日本人に人気の海外リゾート地「ハワイ・オアフ島」を対象とした、5 日間の充実したモデル旅行プランを体系化したマインドマップです。初めてハワイを訪れる旅行者、リピーター、家族連れやカップルなど、多様なニーズに対応するため、旅行基本情報・持ち物チェックリスト・5 日間詳細スケジュール・オプションプラン・事前準備情報の 5 つの軸で構成されています。対象読者は日本からオアフ島へ旅行を計画中の 20〜50 代の旅行者であり、成果指標としては、情報の網羅性(渡航手続きから現地体験まで必要な項目が過不足なく含まれているか)、実用性(移動時間や費用、予約のタイミングなどの正確さ)、体験の充実度(自然・文化・アクティビティ・食事のバランス)を測定します。 ユーザーニーズ分析では、渡航準備・現地移動・体験プラン・安全情報の 4 領域を掘り下げます。渡航準備においては、ESTA 申請、飛行機の予約、為替、パスポートの有効期限、海外旅行保険など、事前に整えるべき情報が不足していると計画が難しくなります。求められる価値としては、渡航に必要な手続きの流れ、必要な持ち物リスト、季節別の服装アドバイス、現地で使えるアプリや連絡先などが考えられます。現地移動では、ワイキキ内の徒歩・バス移動、レンタカーの利用方法、空港からのアクセス、交通機関のルール(右側通行など)が主な関心事です。悩みとしては、バスの路線が分からない、レンタカーの予約手続きが不安、現地での移動時間の目安が分からないなどが挙げられます。体験プランでは、ビーチでのんびり、ダイヤモンドヘッドのハイキング、ノースショアでのサーフィン、ハレイワタウン散策、ポリネシアン・カルチャーセンターでの文化体験など、オアフ島の魅力を網羅したプランが求められます。悩みとしては、限られた日数で主要スポットを効率よく回れない、予算に合ったアクティビティの選び方が分からない、人気のレストランやショップの情報が不足しているなどが挙げられます。安全情報では、ハワイ特有の注意点(紫外線対策、海での安全ルール、治安情報)、緊急時の連絡先、現地でのトラブル対応方法など、旅行者が不安に感じる点を整理することが重要です。 5 日間のモデルコースでは、各日のテーマを明確に設定し、体験のバランスを考慮しています。1 日目は「到着日・ワイキキ慣らし」として、ホノルル国際空港に到着後、ワイキキのホテルにチェックインし、夕方からワイキキビーチでのんびりしたり、夜は地元料理を味わったりして、ハワイの雰囲気に慣れる行程です。2 日目は「自然体験&ショッピング」として、午前中にダイヤモンドヘッドのハイキングに挑戦し、午後はアラモアナセンターやワイキキでショッピングを楽しみ、夜はハワイアン・ルアウショーを鑑賞する行程です。3 日目は「歴史文化巡り」として、イオラニ宮殿やパールハーバー(真珠湾)を訪れてハワイの歴史に触れ、午後はダウンタウンホノルルで街歩きをし、夜はインターナショナルマーケットプレイスで食事や買い物を楽しむ行程です。4 日目は「北海岸&大自然体験」として、オプションでノースショアへ向かい、ハレイワタウンで散策したり、サーフィンを体験したり、美しいビーチでのんびり過ごす行程で、夜はワイキキに戻って食事を楽しみます。5 日目は「最終日・思い出作り」として、午前中にワイキキビーチでの最後の散策や、お土産を買いに街を巡り、午後は空港へ移動して帰国する行程です。各日には、おすすめの時間帯、混雑しにくいタイミング、予約が必要なアクティビティの情報などを付け加え、実際に旅行する際の参考になるよう工夫しています。 また、テンプレートには持ち物チェックリストも含まれており、パスポート・ESTA、海外旅行保険証書、現金・クレジットカード、日焼け止め・帽子・サングラス、歩きやすい靴、薬、充電器など、海外旅行に必要なアイテムをリストアップしています。さらに、事前準備情報として、ネット環境の確保、現地で使えるアプリ、緊急連絡先、季節別の服装アドバイスなども記載し、旅行者の不安を解消するようサポートします。 EdrawMind のマインドマップ機能を活用することで、ユーザーは自身の旅行スタイルに合わせて行程を追加・削除したり、好みのアクティビティをハイライトしたりすることができます。例えば、ゆっくりリゾートを楽しみたい方はショッピングやハイキングの時間を減らしてビーチでの時間を増やしたり、アクティブに過ごしたい方はノースショアでのサーフィンやダイビングを追加したりするなど、カスタマイズも自由自在です。このテンプレートは、オアフ島の旅行計画を立てる際の基盤として活用することを想定しており、主要な情報が一目で分かるよう整理されているため、初めてハワイを

- 奈良 1 泊 2 日旅行プラン マインドマップテンプレート

本テンプレートは、古都・奈良の世界遺産、鹿とのふれあい、歴史的な雰囲気を存分に楽しむための 1 泊 2 日旅行プランを体系化したマインドマップです。修学旅行や短期文化旅行、週末の小旅行に人気の奈良を対象に、イメージ・種類・交通・宿泊の 4 つの基本軸を設け、2 日間の具体的な行程を時系列で整理しています。対象読者は大阪・京都在住の 20〜40 代の一人旅・カップル・家族連れ、初めて奈良を訪れる旅行者、世界遺産や日本文化に興味のある層であり、成果指標としては、行程の網羅性(主要スポットが過不足なく含まれているか)、実用性(移動時間や混雑情報の正確さ)、体験の充実度(鹿とのふれあい・文化体験の満足度)を測定します。 ユーザーニーズ分析では、行程・体験・交通・注意点の 4 領域を掘り下げます。行程においては、「東大寺」「春日大社」「奈良国立博物館」といった世界遺産の回り方、「奈良公園」での鹿とのふれあい、「奈良町」の古い町並み散策がユーザーの関心事となります。悩みとしては、限られた時間で主要スポットを効率よく回れない、鹿との接し方が分からない、徒歩移動の負担が心配などが挙げられます。求められる価値としては、時間帯別のおすすめルート、鹿と安全に接するためのマナー説明、無理のない徒歩移動のための休憩ポイント案内が考えられます。体験面では、鹿せんべいの購入場所や与え方、春日大社の灯篭や御朱印の魅力、奈良町のカフェや伝統工芸体験など、現地でしか味わえない体験情報が求められます。交通においては、奈良市内のバス路線や一日券の情報、主要スポット間の徒歩時間、雨天時の移動手段など、事前に知っておくべき情報が不足していると計画が難しくなります。注意点では、天候対策(夏の暑さや冬の寒さ)、スケジュールのゆとり作り、写真撮影のルールやマナー、ゴミの持ち帰りなど、旅行者が見落としがちな点を整理することが重要です。 行程の中でも、特に人気の高いスポットには詳細な情報を盛り込んでいます。「東大寺」は世界遺産に登録されており、奈良時代に建立された日本を代表する寺院で、世界最大級の木造建築物である大仏殿や、高さ約 15 メートルの盧舎那仏(奈良の大仏)が有名です。事前にコインロッカーに荷物を預けて身軽になってから訪れることで、ゆっくりと境内を散策できるほか、大仏殿の柱の穴をくぐると「厄除けになる」という言い伝えもあり、多くの観光客が体験しています。「奈良公園」は東大寺や春日大社を含む広大な公園で、約 1,300 頭の野生の鹿が自由に生息しており、鹿せんべいを使って鹿とふれあうことができます。ただし、鹿は野生動物であるため、エサの与え方や触れ方には注意が必要で、事前にルールを確認しておくことが推奨されます。「春日大社」は朱色の社殿と美しい灯篭が特徴的な世界遺産で、参道には 3,000 基を超える石灯篭が並び、神聖な雰囲気を醸し出しています。特に夜間にライトアップされた灯篭は幻想的で、写真撮影にも人気です。 1 泊 2 日のモデルコースでは、初日に東大寺・奈良公園・春日大社を巡り、夜は奈良町の古い町並みを散策して地元料理を味わう行程を提案しています。二日目には、若草山から奈良の街並みを一望した後、興福寺や奈良国立博物館を訪れ、奈良町で伝統工芸体験やカフェ巡りを楽しんでから帰路に就く流れとなっています。各スポットには、徒歩時間や混雑しにくい時間帯、おすすめの食事処などの情報を付け加え、実際に旅行する際の参考になるよう工夫しています。また、旅行の注意点として、スケジュールは体調に合わせて無理のないペースで調整すること、天候に合わせて水分補給や防寒・防暑対策を徹底すること、神社仏閣での写真撮影ルールを守ることなどを記載し、安全で快適な旅行をサポートします。 EdrawMind のマインドマップ機能を活用することで、ユーザーは自身の旅行スタイルに合わせて行程を追加・削除したり、好みのスポットをハイライトしたりすることができます。一人旅向けには静かなカフェ巡りを追加したり、家族連れ向けには鹿とのふれあい体験を充実させたりするなど、カスタマイズも自由自在です。このテンプレートは、奈良の旅行計画を立てる際の基盤として活用することを想定しており、主要な情報が一目で分かるよう整理されているため、初めて奈良を訪れる方でも安心して旅行を楽しむことができます。

- 箱根 週末旅行ガイド

本テンプレートは、東京から約90分でアクセス可能な温泉・富士山・美術館が融合したリゾート地「箱根」の週末旅行ガイドを体系化したマインドマップです。カップルや家族連れに人気の週末旅行先として、交通アクセス、観光スポット、名物料理の3軸で構成され、効率的な旅行計画と満足度の高い体験を実現することを目的としています。対象読者は東京在住の20〜40代のカップル・家族連れ、初めて箱根を訪れる旅行者、週末の小旅行を計画中の層であり、成果指標としては、情報の網羅性(必要な項目が過不足なく含まれているか)、実用性(実際の移動時間や料金の正確さ)、満足度(モデルプランの再現性)を測定します。 ユーザーニーズ分析では、交通アクセス、観光スポット、グルメの3領域を掘り下げます。交通アクセスにおいては、東京からの行き方(小田急ロマンスカー約85分・指定席、新宿→箱根湯本、普通電車約2時間・乗換2回)、箱根内の移動手段(登山電車・バス・ケーブルカー・ロープウェイ)、お得な周遊券(箱根フリーパス・2日券)の情報が不足していると計画が難しくなります。求められる価値としては、交通機関別の所要時間・料金・乗換回数を比較した表、周遊券の特典内容(主要観光施設の割引)と購入場所、移動手段ごとのメリット・デメリットが考えられます。観光スポットでは、「箱根ガラスの森美術館」「クモ箱根(早雲山駅)」「芦ノ湖の夕暮れ遊覧船」などが代表的です。悩みとしては、美術館や自然スポットが多すぎて選べない、夕暮れ時の遊覧船のベストタイミングが分からない、写真映えするスポットを知りたいなどが挙げられます。価値ある情報として、おすすめスポットの特徴と所要時間、夕暮れ時の撮影ポイント、カップル向け・家族向けの選別基準を提供します。名物料理では、「黒たまご(大涌谷)」「温泉豆腐」などが代表的です。悩みは、どこで何を食べれば良いか分からない、観光地価格に見合う価値があるか、アレルギーや食事制限への対応などです。求められる価値として、名物料理の特徴とおすすめ店舗、価格帯、食べるタイミング(例:黒たまごは大涌谷観光の合間に)を整理します。 カップルにおすすめスポットとして、「箱根ガラスの森美術館」はユネスコ世界遺産(※正確には箱根地域全体がジオパークに認定されていますが、イメージとして)の美しい庭園とガラス作品が魅力です。写真はイメージですが、実際の訪日客にも人気のスポットです。名物料理のセクションでは、「黒たまご」は大涌谷の火山活動を利用して茹でられた卵で、殻が黒くなるのが特徴です。伝統的な名物料理として、食べると寿命が延びると言われています。「温泉豆腐」も地元の温泉を利用した料理で、なめらかな食感が特徴です。これらの情報をマップ上で可視化し、移動ルートと組み合わせることで、無駄のない観光計画が立てられます。 成功するための具体施策としては、主要スポットを時系列で結んだ「1泊2日モデルコース」を提供する(例:1日目:新宿→箱根湯本→登山電車→強羅→大涌谷→芦ノ湖遊覧船→宿泊、2日目:箱根ガラスの森美術館→箱根湯本→帰京)、各スポットの「混雑予想時間帯」と「穴場時間帯」をデータで示す(例:芦ノ湖遊覧船は夕暮れ時が混雑するが、その分景色は絶景)、名物料理を食べられる店舗の「営業時間・定休日・予約可否」をリスト化する、の3点が有効です。よくある失敗とその回避策としては、移動手段の乗換えが複雑で迷ってしまうケースでは箱根フリーパスの活用と事前のルート確認を推奨すること、観光スポットの滞在時間を見誤って計画が詰まりすぎるケースでは余裕を持ったスケジューリングと優先順位付けをアドバイスすること、天候によって富士山が見えない場合の代替プラン(雨天でも楽しめる美術館や温泉施設)を用意しておくことが有効です。本テンプレートは、週末旅行ガイドのコンテンツを計画・評価する際の基盤として活用することを想定しています。

- Recommended to you

- Outline

Machine learning algorithm linear regression decision tree notes self-study mind map

K-nearest neighbor algorithm

Algorithm principles and API

The concept and principle of K-nearest neighbor algorithm

concept

If most of the k most similar (i.e. nearest neighbors in feature space) samples of a sample belong to a certain category, then the sample also belongs to this category.

feature space

A space established using all features as coordinate axes. In the feature space, each sample is a point.

[Key points] Principle and implementation steps

1. Calculate the distance between the point in the known category data set and the current point

2. Arrange these distances in ascending order

3. Select the k points with the smallest distance from the current point

4. Count the frequency of occurrence of the category where the first k points are located (find the mode of the K categories)

5. Use the mode category as the category of the current point

K-Nearest Neighbor Algorithm API

Introduction to Scikit-learn

Machine learning tools that implement numerous machine learning algorithms

API

sklearn.neighbors.KNeighborsclassfier(n_neighbors)

Algorithm calculation and optimization

measure of distance

Euclidean distance

Manhattan distance (block distance)

Chebyshev distance

Minkowski distance (Min's distance)

Normalized Euclidean distance

cosine distance

Hamming distance

String lengths are equal

Calculate distance of string

Jaccard distance

distance between two sets

Mahalanobis distance

The impact of the choice of K value on the model

Performance of underfitting and overfitting

approximation error

The error of the model on the training set

estimation error

The error of the model on the test set

Underfitting

The approximation error is large and the estimation error is large. To put it bluntly, the model performs poorly on both the training set and the test set.

overfitting

The approximation error is small, but the estimation error is large. To put it bluntly, the model performs well on the training set but not on the test set.

K value is too small

Largely affected by outliers

The model is complex, has strong learning ability, and is prone to overfitting.

K value is too large

The impact of sample imbalance is large

The model is simple, has weak learning ability, and is prone to underfitting.

kd tree

kd tree introduction

tree concept

root node

Nodes with only child nodes and no parent nodes

internal node

Nodes that have child nodes and parent nodes

leaf node

Nodes with only parent nodes and no child nodes

Binary tree

A tree with at most two forked nodes

The role of kd tree

Reduce the number of calculations of sample distance and quickly find the nearest neighbor point

Construction method of kd tree

1. Randomly select a feature, take the median of this feature as the dividing point to divide the data into two equal parts. The selected feature is the dividing feature of the current node, and the median point is used as the current node. On this feature, points smaller than the median are classified into the left node, and points larger than the median are classified into the right node;

2. Repeat the first step for the data on the left node and the right node respectively;

3. Until all samples are placed on the node

How to find the nearest point in kd tree

1. Compare the query point M with the dividing characteristics and corresponding median of each node on the kd tree, and continue to compare downward until reaching the leaf node. Record in order the nodes traveled through the entire process search_path;

2. The node at the end of search_path is N, do not take out N, record the distance between dist=M and N, nearest=N;

3. Take out a node L from the end of search_path, the dividing axis of this node is x, calculate the distance a from point M to the x axis, and then handle it in two cases:

If a<dist, then all points in the space on the other side divided by node L and the current nearest point are included in the investigation range, the distances from all points in the investigation range to point M are calculated, the nearest point is found, and the point is recorded as nearest. The distance from this point to M is dist, discard node L, and the step ends;

If a>=dist, discard node L and the step ends

4. Repeat step 3 until search_path is empty;

5. Nearest is the point closest to the search point, and the nearest distance is dist.

Case 1

Introduction to the dataset API of scikit-learn

sklearn small data set

API: load_* Such as: load_iris()

sklearn big data set

API: fetch_* Such as: fetch_20newsgroups(sub_set='train')

Parameter description: sub_set='train' specifies the type of data set to be obtained

Introduction to sklearn data set return value

Data type: datasets.base.Bunch (dictionary format)

data: feature data array

target: array of labels (target values)

feature_names: feature names

target_names: tag names

keys() gets all attributes (fields) of the dictionary

Draw a scatter plot of data and find outliers

sns.lmplot(col1, col2, data, hue, fit_reg)

Partition of the data set

x_train, x_test, y_train, y_test = trian_test_split(x, y, test_size)

Feature preprocessing using sklearn

Normalized

Disadvantages of normalization: greatly affected by outliers

API: MinMaxScaler(feature_range)

Function: Convert data to between 0 and 1

standardization

API:StandarScalar()

Function: Convert data to mean=0, std=1

Iris flower species prediction

Case 2

Cross-validation and grid search

Cross-validation

Divide the training set evenly into N parts, take a different part as the verification set, and the other part as the training set, train and verify the model performance, and use the average of the N times of model performance as the performance of the model on this training set.

grid search

Find the optimal combination of hyperparameters

API

sklearn.model_selection.GridSearchCV(estimator, param_grid, cv)

Predict Facebook check-in location

linear regression

Introduction to Linear Regression

Mathematical formula (mathematical model) of linear regression

h(w) = w1*x1 w2*x2 w3*x3 ... wn*xn b

The concept of hyperplane

The n-1 dimensional linear relationship in n-dimensional space is called a hyperplane in n-dimensional space.

API

sklearn.linear_model.LinearRegression()

Losses and Optimization for Linear Regression

loss function

1. The loss function is a function of the trainable parameters

2. The smaller the value of the loss function, the closer the model’s predicted value is to the true value.

Optimization method of linear regression

normal equation

Calculate optimal parameters directly

NOTE: Applicable only to linear regression models with least squares loss

gradient descent method

Continuously iterate through gradients to find optimal trainable parameters

General optimization methods

Loss function Gradient descent is the most common model optimization method

gradient descent method

Full Gradient Descent Algorithm (FG)

Stochastic Gradient Descent Algorithm (SG)

Stochastic Average Gradient Descent Algorithm (SAG)

Mini-batch gradient descent algorithm (mini-bantch)

Case-Boston House Price Forecast

Regression performance evaluation API: sklearn.metrics.mean_squared_error(y_true, y_pred)

Normal equation optimization linear regression API: sklearn.linear_model.LinearRegression()

Optimizing linear regression with stochastic gradient descent: sklearn.linear_model.SGDRegressor()

Overfitting and underfitting

Underfitting

Definition: The model performs poorly on both the training set and the test set

Solution: Increase model complexity

Increase the number of features of the data

Add polynomial terms

overfitting

Definition: The model performs well on the training set, but does not perform well on the test set

Solution: Reduce model complexity

Clean the data again

Increase the amount of training data

Regularization

L1 regularization: You can make some of the W values directly 0, removing the influence of this feature. Can be used for feature selection

L2 regularization: It can make some of the W's very small and close to 0, weakening the influence of a certain feature.

Reduce the number of features

regularized linear model

ridge regression

Linear regression L2 regularization

Lasso returns

Linear regression L1 regularization

elastic network

Linear regression L1 L2

ridge regression

Linear regression with L2 regularization

API: Ridge(alpha)

Saving and loading models

Save: joblib.dump(estimator, path)

Loading: joblib.load(path)

logistic regression

The principles of logistic regression

Mathematical model: linear regression activation function (sigmoid)

The role of the activation function: increase the nonlinear fitting ability of the model

Loss function: Log-likelihood loss

Optimization method: gradient descent

API: sklearn.linear_model.LogisticRegression()

How to evaluate classification models

Classification evaluation report API: classification_report(y_true, y_pred, label, target_names)

ROC curve

TPR = TP / (TP FN)

FPR = FP / (FP TN)

Adjust the threshold to obtain multiple (FPR, TPR) points and draw the ROC curve

AUC indicator

Meaning: randomly select a pair of positive and negative samples, the probability that the score of the positive sample is greater than that of the negative sample

API: roc_auc_score(y_true, y_score), note: y_true must use 0, 1 to mark false cases and positive cases

decision tree

Introduction to decision tree algorithm

Decision tree is a tree structure

Each internal node represents the judgment of a feature

Each branch represents the output of a judgment result

Each leaf node represents a classification result

The principle of decision tree

Feature selection and division basis of decision tree nodes

entropy

A measure of “chaos”

entropy = -p1logp1 - p2logp2 ... pn*log(pn)

information gain

The difference in entropy before and after dividing the data set by a certain feature

Information gain = entroy(before) - entroy(after)

The greater the information gain, the better the classification method of this feature.

information gain rate

Information gain/separated information metric

Separation information measure = entropy calculated from the probability of occurrence of each category of a feature

Gini gain

Gini value: The probability that two samples randomly selected from the data set D have inconsistent target values (labels)

The smaller the Gini value, the higher the purity of the data set.

Gini gain = Gini value (before) - Gini value (after)

The greater the Gini value gain, the better this division method is.

Steps to build a decision tree

1. Start looking at all samples as a whole

2. Traverse each segmentation method of each feature and find the best segmentation (based on information gain, information gain rate, and Gini value gain)

3. According to the optimal division method, divide all samples into two parts N1 and N2, that is, two branches

4. Continue steps 2-3 for N1 and N2 until each node is "pure" enough.

According to different node selection and division basis, the decision tree is divided into

ID3 decision tree: information gain

C4.5 Decision Tree: Information Gain Rate

CART decision tree: Gini value gain (or Gini index)

cart pruning

Purpose: Reduce the number of decision tree nodes -> Reduce the complexity of the decision tree -> Prevent the decision tree from overfitting

method

Pre-pruning: Pruning when creating a decision tree

The minimum number of samples contained in each node, such as 10. If the total number of samples at the node is less than 10, no classification will be performed.

Specify the height or depth of the tree, for example, the maximum depth of the tree is 4

If the entropy of the specified node is less than a certain value, it will no longer be divided.

Post-pruning: pruning after creating the decision tree

The method is similar to pre-pruning

Feature Engineering: Feature Extraction

Dictionary feature extraction

sklearn.feature_extraction.DictVectorizer(sparse=True)

Note: This method will automatically one_hot encode discrete data

Text feature extraction

word occurrence count

sklearn.feature_extraction.text.CountVectorizer(stop_words=[])

Tf-idf text feature extraction

TF: word frequency

Refers to the frequency of a given word appearing in the document

IDF: inverse document frequency

Divide the total number of documents by the number of documents containing the word, and then take the base 10 logarithm of the quotient to get

TF-IDF

TF-IDF = TF*IDF

Function: Evaluate the importance of a word to a document set or a document in a corpus

API:sklearn.feature_extraction.text.TfidfVectorizer(stop_works)

Note: To extract features from Chinese articles, word segmentation must be performed first.

Stuttering participle: jieba.cut

Case: Titanic passenger survival prediction

Decision tree API: sklearn.tree.DecisionTreeClassifier(criterion=’gini’, max_depth=None,random_state=None)

Decision tree visualization: sklearn.tree.export_graphviz()

Summarize

Advantages of decision trees: simple, interpretable, and visualizable

Disadvantages of decision trees: easy to overfit

Solution

pruning

random forest

Ensemble learning

Introduction to ensemble learning algorithms

Generate multiple classifiers/models, each learning and making predictions independently. These predictions are ultimately combined into a combined prediction that is better than any single classification prediction.

boosting -> underfitting

bagging -> overfitting

Bagging ensemble learning

Principle: Build multiple models in parallel, and the models are independent of each other

1. Sampling: Sampling N pieces of data with random replacement

2. Learning: Use N pieces of data to learn N different models

3. Integration: Through equal voting of N models, the one with the most votes will be the final result.

random forest

What is random forest: bagging decision tree

API:sklearn.ensemble.RandomForestClassifier(n_estimators, max_depth)

advantage

Both methods can improve the generalization accuracy rate by about 2% on the original algorithm.

Simple, convenient and versatile

Boosting integration principle: Build multiple models in series, and the model built later is affected by the model built previously.

1. Initialize the training weights, make the weights equal, and train the first learner (model)

2. Calculate the error rate of the learner in the training data

3. Calculate the weight of the learner based on the error rate

4. Reweight the training data according to the weight of the learner

5. Repeat steps 1~4 m times

6. Weighted voting on the results of m models to obtain the final result

clustering

Introduction to clustering algorithms

Clustering algorithm is a typical unsupervised learning algorithm, mainly used to automatically classify similar samples into a category

The biggest difference between clustering algorithms and classification algorithms: clustering algorithms are unsupervised learning algorithms, and classification algorithms are supervised learning algorithms.

Initial use of clustering algorithm API

sklearn.cluster.KMeans(n_clusters=8)

Prediction method: Call fit_predict(X) to get the classification results

Clustering algorithm implementation process (principle)

1. Randomly select K samples as the centers of K categories;

2. Calculate the distance from all samples to the center;

3. Which category the sample is closest to the center;

4. After dividing K categories, recalculate the coordinates of the center. The calculation method is that the average value of each feature value of the samples in the category is used as the corresponding coordinates of the new center;

5. Repeat steps 2, 3, and 4 until the coordinates of the center no longer change.

Model evaluation for clustering

Sum of squared errors: the sum of the squared distances (Euclidean distance) of all samples to the corresponding category center

"Elbow" method: when the decline rate suddenly slows down, it is considered to be the best k value

SC silhouette coefficient: The value is [-1, 1]. The larger the value, the better. If it is a negative value, the sample may be classified incorrectly.

CH coefficient: The higher the score s, the better the clustering effect.

Algorithm optimization

Canopy algorithm with initial clustering

K-means

Bipartite k-means

ISODATA

kernel kmeans

Mini-batch K-Means

Feature dimensionality reduction

Feature selection

Remove low variance features

Pearson correlation coefficient

Spearman correlation coefficient

Principal Component Analysis PCA

Case: Exploring user preferences for item categories and dimensionality reduction